Big Data im logistischen Umfeld

Unternehmen in der Logistik stehen heute vor großen Herausforderungen. Zum einen muss der steigenden Komplexität und zum anderen Trends wie einer höheren Vielfalt, kürzeren Produktlebenszyklen, sowie immer höheren regulativen Rahmenbedingungen Rechnung getragen werden.

Zum anderen stehen die Unternehmen unter höheren Wettbewerbsdruck, wodurch sie gezwungen sind Produkte schneller an den Markt zu bringen, Mehrwertdienste zu den Produkten anzubieten und gleichzeitig die Kosten zu senken. Die Logistik, welche durch Transporte und Warenlieferungen, Unternehmen entlang von Liefernetzwerken miteinander verbindet kommt hierbei eine besondere Rolle zu. Bessere Planungsmöglichkeiten, auch durch eine verbesserte Sichtbarkeit bis zur vollständigen Transparenz aller logistischen Abläufe sind bald unerlässlich um die steigende Komplexität weiterhin zu beherrschen.

Dazu sagt das Fraunhofer Institut für Materialforschung, dass die Daten in den einzelnen Unternehmen im Besondern Fokus stehen. Daten sind aber auch gleichzeitig Treiber dieser Entwicklungen als auch Schlüssel zum Erfolg. Dies wird unterstützt durch neue Industrie 4.0-Entwicklungen und Technologien basierend auf dem Internet der Dinge und cyber-physischen Systemen (CPS). Der hohe Vernetzung Grad von CPS, neuen autonom agierenden Systemen, und den üblichen IT-Systemen in der Logistik, z.B. einem Warehouse-Management-System (WMS), entstehen immer größere Datenmengen direkt im Unternehmen.

In der Logistik eröffnen sich mit der Verwertung großer Datenmengen neue Möglichkeiten. Sowohl in den Unternehmen, in Liefernetzwerken als auch im Internet existieren viele verschiedene Datenquellen, welche zur Entscheidungshilfe sowie zur Erstellung von Prognosen herangezogen werden können und auf diese Weise einen Mehrwert für die Unternehmen generieren. Hierbei spielen die Big Data Technologien und Datenauswertungen eine entscheidende Rolle.

Diese Technologien sind vor allem für die Auswertung und Nutzung von Sensor- und AutoID-Daten (Daten von RFID- und Barcode-Lesegeräten) interessant. Vor allem letztere werden immer häufiger standort- und unternehmensübergreifend erfasst und zentral zusammengeführt. Für diese Daten stellt sich im Zuge der Integration die Frage, in wie weit diese Daten vorab verdichtet oder als Rohdaten in einen zentralen Datenspeicher - eine NoSQL-Datenbank oder ein verteiltes Dateisystem – überführt und dort für Analysen und Auswertungen vorgehalten werden. Verdichtung kann zum Beispiel die Berechnung von Durchschnittwerten über einen bestimmen Zeitraum oder die Erzeugung von Events, welche Zusammenfassungen bestimmter Vorgänge enthalten, bedeuten. Eine Lösung für entsprechende Fragestellungen ist stark vom jeweiligen Anwendungsfall abhängig. Für ein Gouvernance von Logistikinfrastrukturen - der Verwaltung und Monitoring von IT-Systemen, Fahrzeugen und Materialflussanlagen – reichen verdichtete Sensordaten aus. Für eine detaillierte Analyse von Fehlern oder Unterbrechungen von Auftragsbearbeitung ist jedoch eine Betrachtung von Rohdaten interessant.

Zu einem Big Data Problem wird die Betrachtung von vielen unterschiedlichen Sensoren und AutoID-Readern mit vielen Konfigurationsmöglichkeiten sowie deren Geschwindigkeit bei dem Erzeugen von Events – in der Regel von mehreren Hertz. Diese Daten müssen zusammen mit Auftrags-, Produkt- und Transaktionsdaten aus den WM- und ERP-Systemen sowie weiteren Statistikdaten über zurückliegende Vorgänge ausgewertet werden.

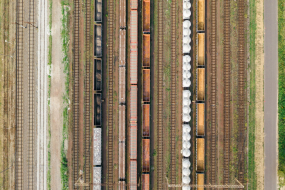

Für Anwendungsfälle, welche nicht nur Wartung und Instandhaltung, sondern auch die Planungen von Anpassungen und Erweiterungen der Anlagen bis hin zur Entwicklung von neuen Logistikdienstleistungen betrachten, ist die Nutzung all dieser Daten von großen Interesse. Der Mehrwehrt ist im Besonderen die Verbesserung der Sichtbarkeit über den Material- und Informationsfluss. Engpässe in Vorgängen und Materialbewegungen können einfacher aufgedeckt und Transport neu und besser geplant werden.